Sicurezza informatica: la grande illusione

Introduzione: tutti si sentono al sicuro

La sicurezza informatica è oggi percepita come una realtà consolidata. I sistemi sono definiti “protetti”, le reti “difese”, le infrastrutture “sicure”.

Firewall attivi, antivirus aggiornati, sistemi di cifratura avanzati: tutto contribuisce a costruire una narrazione precisa — quella di un ambiente digitale sotto controllo.

Ma questa sicurezza esiste davvero, oppure è una costruzione necessaria per rendere accettabile un contesto intrinsecamente vulnerabile?

La questione non è marginale, perché riguarda il presupposto su cui si basa l’intero ecosistema digitale: la fiducia.

Il presupposto ignorato: ogni sistema è attaccabile

Ogni sistema connesso a una rete espone una superficie di attacco.

Non è un’eventualità.

È una proprietà strutturale.

Qualsiasi software complesso contiene errori. Questo non è un difetto occasionale, ma una conseguenza inevitabile della complessità. Milioni di righe di codice implicano inevitabilmente la presenza di vulnerabilità, note o sconosciute.

Un sistema accessibile può essere analizzato, reverse-engineered, sottoposto a Fuzz Testing fino a individuare comportamenti anomali.

In questo contesto, parlare di sicurezza come stato raggiunto è fuorviante.

La sicurezza non è un risultato definitivo.

È un equilibrio temporaneo tra chi difende e chi attacca.

Vulnerabilità sconosciute: il problema prima della soluzione

Il concetto di Zero-day vulnerability evidenzia il limite strutturale di qualsiasi approccio difensivo.

Una vulnerabilità esiste indipendentemente dal fatto che sia conosciuta.

Nel tempo che intercorre tra la sua esistenza e la sua scoperta — che può durare mesi o anni — il sistema è esposto senza alcuna possibilità di difesa mirata.

Questo implica una conseguenza chiara:

la sicurezza non può essere preventiva in senso assoluto.

Può solo reagire. Sempre in ritardo.

E ogni patch, ogni aggiornamento, ogni correzione rappresenta la prova implicita che il sistema, fino a quel momento, non era sicuro.

Exploit e limiti del controllo

Tecniche come il Buffer overflow, use-after-free, privilege escalation o code injection non sono eccezioni rare, ma categorie consolidate di attacco.

Sono il risultato diretto di errori nella gestione della memoria, nella validazione degli input, nella logica applicativa.

E soprattutto, non sempre producono effetti visibili.

Un sistema può continuare a funzionare apparentemente in modo corretto mentre esegue codice malevolo, concede accessi non autorizzati o espone dati sensibili.

L’assenza di errori evidenti non è sinonimo di sicurezza.

È spesso solo assenza di rilevazione.

La sicurezza come probabilità, non come stato

Firewall, antivirus, sistemi di intrusion detection e prevention: strumenti indispensabili, ma spesso sopravvalutati nella percezione comune.

Il loro ruolo reale non è garantire sicurezza, ma ridurre la probabilità di compromissione entro determinate soglie.

Ogni sistema di difesa si basa su firme, comportamenti noti, pattern già osservati.

Ma un attacco nuovo, non classificato, può semplicemente non essere riconosciuto.

La sicurezza, quindi, non è una condizione garantita.

È una probabilità gestita in funzione di ciò che si conosce.

E ciò che non si conosce resta fuori dal perimetro della difesa.

Il paradosso della connessione

Ogni connessione aumenta il valore di un sistema.

Accessibilità, integrazione, scalabilità: sono elementi fondamentali per il funzionamento dell’infrastruttura moderna.

Ma ogni connessione introduce una nuova superficie di attacco.

API esposte, servizi cloud, accessi remoti, interconnessioni tra sistemi: ogni punto di contatto è un potenziale punto di ingresso.

Più un sistema è utile, più è aperto.

Più è aperto, più è vulnerabile.

La sicurezza, quindi, cresce in complessità esattamente quanto cresce l’utilità del sistema.

E spesso non riesce a tenere il passo.

L’unico sistema realmente sicuro

Se si elimina ogni ambiguità teorica, la conclusione è inevitabile:

l’unico sistema realmente sicuro è quello isolato.

Nessuna rete.

Nessun accesso remoto.

Nessuna interazione esterna.

Nessuna superficie di attacco.

Tutto il resto — per quanto protetto — resta esposto per definizione.

Non esistono sistemi inviolabili.

Esistono sistemi non ancora violati, o violati senza che sia stato rilevato.

Conclusione: sicurezza o condizione temporanea?

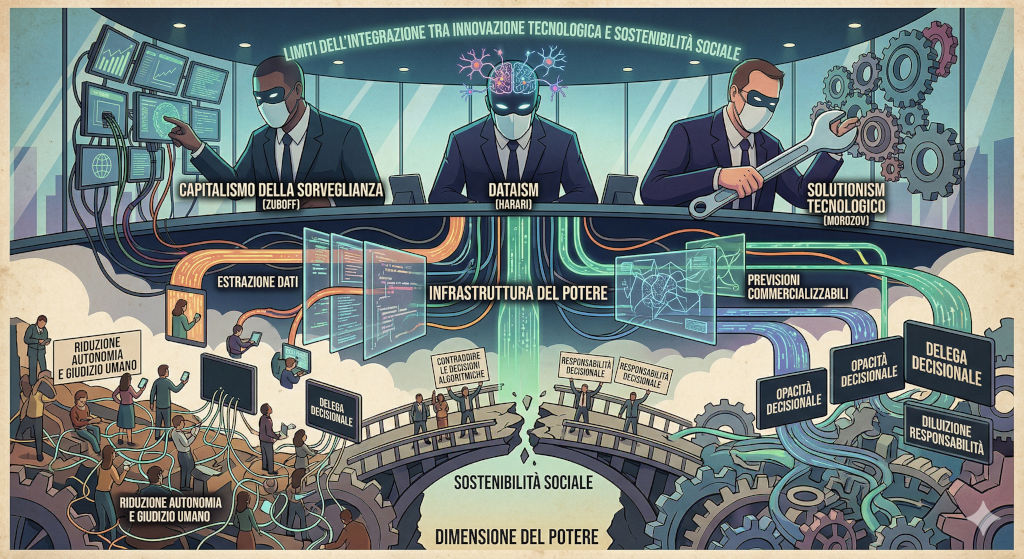

Si continuerà a parlare di sicurezza informatica come di una realtà stabile, perché è necessario farlo.

Un sistema percepito come insicuro sarebbe semplicemente inutilizzabile.

Ma questa percezione non modifica la realtà tecnica.

In un ambiente complesso e connesso, la sicurezza non è mai definitiva.

È temporanea.

Dipende da ciò che è noto, da ciò che è stato corretto, da ciò che non è ancora stato scoperto.

E quando si osservano fenomeni come deepfake, compromissioni di infrastrutture, esposizioni massive di dati, non si tratta di eccezioni.

Sono manifestazioni visibili di una condizione strutturale.

Perché in un sistema in cui ogni elemento è potenzialmente vulnerabile,

la vera distinzione non è tra sicuro e insicuro,

ma tra ciò che è già stato compromesso

e ciò che non lo è ancora… o non è stato ancora scoperto.